谷歌周二公布了其最新的语言突破,开发了一种名为 LaMDA(对话应用程序的语言模型)的会话语言模型。 谷歌在其 I/O 大会的主题演讲中讨论了新模型。

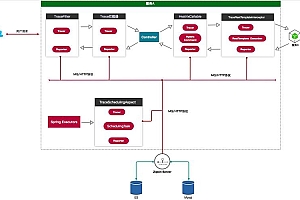

与其他最近开发的语言模型(包括 BERT 和 GPT-3)一样,LaMDA 建立在 Transformer 之上,Transformer 是 Google Research 于 2017 年发明并开源的神经网络架构。

然而,与其他语言模型不同的是,谷歌的 LaMDA 接受了对话训练,教它如何进行流畅的对话。 该培训教会了 LaMDA 提供不仅在特定背景下有意义而且具体的响应。

谷歌给出了一个提示“我刚开始上吉他课”的例子。 一个明智而具体的回应可能是,“多么令人兴奋!我妈妈有一把她喜欢弹奏的老式马丁琴。”

谷歌还在探索如何为回复添加维度,例如“有趣度”,其中可能包括有洞察力、出人意料或诙谐的回复。 它还致力于确保回复在事实上是正确的并符合谷歌的 AI 原则。