机器学习依赖于海量数据,通过寻找数据中的模式来发挥作用,这在人工智能领域是司空见惯的说法。

事实上,“在数据中寻找模式”这个短语多年来一直是数据挖掘和知识发现等事物的主要短语,并且人们一直认为机器学习,尤其是它的深度学习变体,只是在继续 寻找这种模式的传统。

人工智能程序确实会产生模式,但是,正如“亲爱的布鲁图斯,错不在我们的星星,而在我们自己”,这些模式的事实并不存在于数据中,而是人工智能程序所做的 的数据。

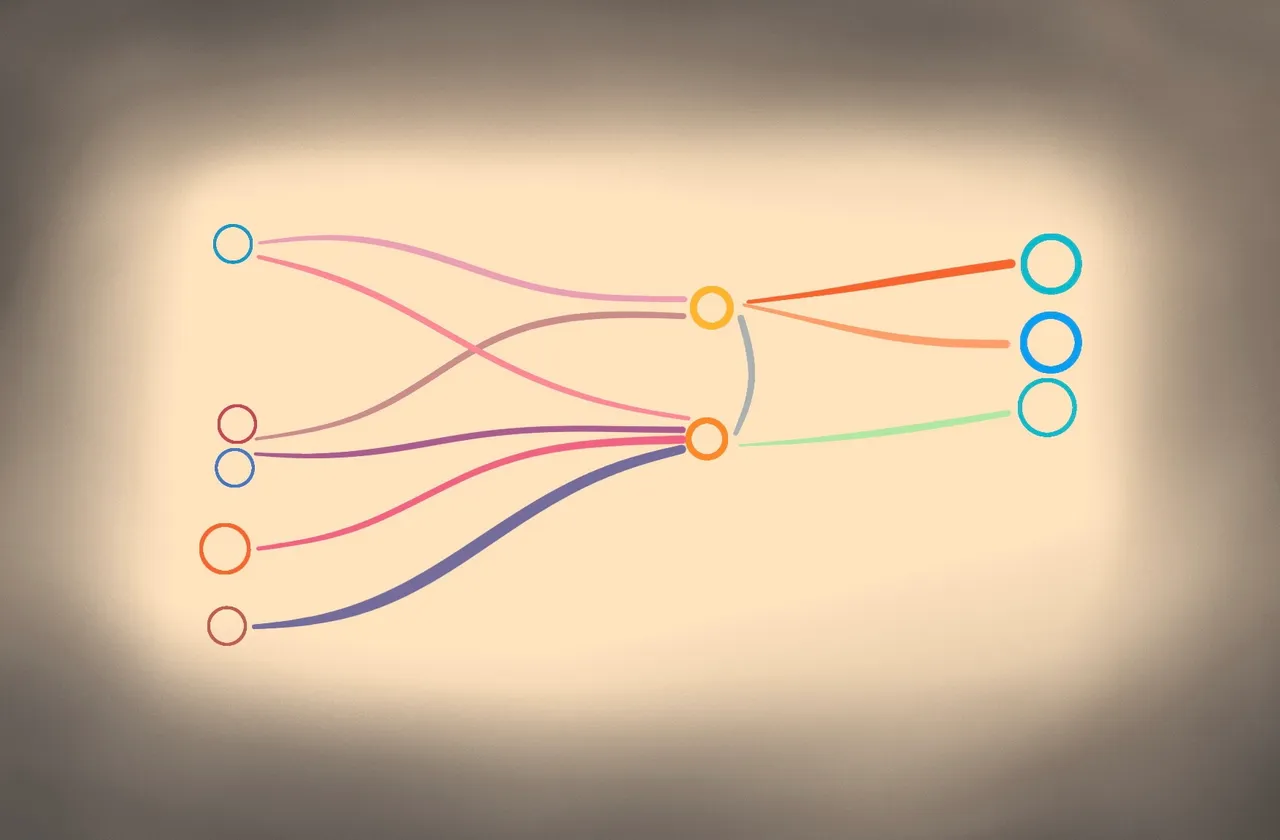

几乎所有的机器学习模型都通过一个学习规则来运行,该学习规则会在程序被提供数据示例以及可能附加到该数据的标签时改变程序的所谓权重(也称为参数)。 权重的值才算作“知道”或“理解”。

正在发现的模式实际上是权重如何变化的模式。 权重正在模拟真实神经元被认为是如何“发射”的,这是心理学家 Donald O. Hebb 形成的原理,后来被称为赫布学习,即“一起发射的神经元,连接在一起”的想法。

还有:六十秒后的人工智能

权重变化的模式是机器学习中学习和理解的模型,这是深度学习的创始人所强调的。 正如近四十年前所说,在深度学习的基础文本之一《并行分布式处理》第一卷中,James McClelland、David Rumelhart 和 Geoffrey Hinton 写道:

存储的是允许创建这些模式的单元之间的连接强度 […] 如果知识是连接的强度,那么学习必须是找到正确的连接强度的问题,以便产生正确的激活模式 在适当的情况下。

McClelland、Rumelhart 和 Hinton 是为特定的读者、认知心理学家和计算机科学家写作的,他们在一个截然不同的时代写作,在这个时代,人们不会轻易假设计算机所做的任何事情都代表“知识”。 他们在 AI 程序根本做不了多少事情的时候工作,他们主要关心如何从相当有限的晶体管排列中产生计算——任何计算。

然后,从大约 16 年前强大的 GPU 芯片的兴起开始,计算机确实开始产生有趣的行为,2012 年 Hinton 与他的研究生合作的具有里程碑意义的 ImageNet 性能结束,这标志着深度学习时代的到来。

由于计算机取得了新的成就,大众开始围绕人工智能和深度学习建立各种神话。 大量糟糕的头条新闻将这项技术比作超人的表现。

另外:为什么 AI 报告如此糟糕?

今天的 AI 概念已经模糊了 McClelland、Rumelhart 和 Hinton 关注的重点,即机器,以及机器如何“创造”模式,正如他们所说的那样。 他们非常熟悉权重构建模式的机制,作为对输入中仅数据的响应。

为什么这一切很重要? 如果机器是模式的创造者,那么人们得出的关于人工智能的结论可能大部分都是错误的。 大多数人认为计算机程序正在感知世界上的一种模式,这可能导致人们将判断推迟到机器身上。 如果它产生结果,那么想法就是,计算机一定看到了人类看不到的东西。

除了构建模式的机器没有明确看到任何东西。 它正在构建一个模式。 这意味着“看到”或“知道”的东西与人类自称了解事物的口语化日常意义不同。

与其从以人类为中心的问题出发,不如从机器知道什么开始? 最好从一个更精确的问题开始,这个程序在其权重的连接中代表什么?

根据任务的不同,该问题的答案有多种形式。

考虑计算机视觉。 作为图像识别和其他视觉感知机器学习程序基础的卷积神经网络由一组衡量数字图像中像素值的权重组成。

像素网格已经是对现实世界的二维坐标系的强加。 提供了坐标网格的机器友好抽象,神经网络的表示任务归结为将像素集合的强度与已施加的标签相匹配,例如“鸟”或“蓝鸟”。

在包含一只鸟,或者特别是蓝鸟的场景中,可能会发生很多事情,包括云、阳光和路人。 但整个场景不是问题。 对程序来说重要的是最有可能产生适当标签的像素集合。 换句话说,模式是神经网络连接激活中固有的聚焦和选择的还原行为。

您可能会说,这种程序与其说是过滤,不如说是“看到”或“感知”。

另外:一个新实验:AI 真的认识猫或狗吗?

在游戏中也是如此,AI已经掌握了国际象棋和扑克。 在由 DeepMind 的 AlphaZero 程序掌握的“全信息”棋局中,机器学习任务归结为在每个时刻制定一个潜在的下一步行动最终导致获胜、失败或平局的概率分数。

因为即使是最快的计算机也无法计算未来可能的游戏板配置数量,因此计算机的权重通过执行您可能称之为总结的操作来缩短对移动的搜索。 该程序总结了如果一个人在给定的方向上采取几个行动成功的可能性,然后将该总结与在另一个方向上可能采取的行动的总结进行比较。

尽管棋盘在任何时刻的状态——棋子的位置,以及剩下的棋子——可能对人类国际象棋大师来说“意味着”某种东西,但目前尚不清楚“意味着”一词对于 DeepMind 的 AlphaZero 对于这样的总结任务有什么意义 .

Pluribus 程序也完成了类似的总结任务,该程序在 2019 年征服了最难的扑克形式——无限注德州扑克。 该游戏甚至更加复杂,因为它包含隐藏信息、玩家面朝下的牌以及额外的“随机”虚张声势元素。 但是,这种表示再次是对每轮可能性的总结。

即使在处理人类语言的程序中,权重中的内容也与不经意的观察者可能假设的不同。 GPT-3 是 OpenAI 的顶级语言程序,可以在句子和段落中产生惊人的类似人类的输出。

程序“懂”语言吗? 它的权重表示单个单词甚至整个文本字符串如何与其他单词和字符串按顺序找到的可能性。

您可以将神经网络的该功能称为类似于 AlphaGo 或 Pluribus 的摘要,因为该问题更像是国际象棋或扑克。 但是在神经网络中被表示为连接的可能状态不仅是巨大的,而且考虑到语言的无限组合性,它们是无限的。

另一方面,鉴于 GPT-3 等语言程序的输出是一个句子,是一个模糊的答案而不是一个离散的分数,因此“正确答案”的要求比国际象棋的输赢或平局要低一些 或扑克。 你也可以将 GPT-3 和类似程序的这个功能称为事物权重的“索引”或“清单”。

另外:什么是 GPT-3? 您的企业需要了解的有关 OpenAI 突破性人工智能语言程序的一切信息

人类有类似的库存或语言索引吗? 到目前为止,在神经科学中似乎没有任何迹象表明它。 同样,在“to tell the dancer from the dance”这个表达中,GPT-3 是否发现了短语或关联中的多重意义? 不清楚这样的问题在计算机程序的上下文中是否有意义。

在每一种情况下——棋盘、卡片、字符串——数据就是它们的本来面目:以各种方式分割的成型基材、一组塑料矩形纸制品、一组声音或形状。 这些发明对计算机来说是否“意味着”任何东西,只是说计算机为了某种目的而做出响应而调整的一种方式。

此类数据在机器中提示的东西——过滤器、摘要、索引、库存,或者你想要描述这些表示的任何方式——从来都不是东西本身。 它们是发明。

另外:DeepMind:为什么 AI 如此擅长语言? 这是语言本身的东西

但是,您可能会说,人们看到雪花并看到它们的差异,如果他们愿意的话,还会对这些差异进行分类。 诚然,人类活动一直试图通过各种方式寻找模式。 直接观察是最简单的方法之一,从某种意义上说,神经网络所做的是它的一种扩展。

你可以说神经网络揭示了数千年来人类活动中始终存在的事实,即模式是强加于世界的事物,而不是世界上的事物。 在这个世界上,雪花有形状,但对于收集雪花并对其进行索引和分类的人来说,这种形状只是一种模式。 换句话说,它是一种构造。

随着越来越多的程序被释放到世界数据上,并且它们的权重被调整以形成我们希望创建有用表示的连接,创建模式的活动将急剧增加。 这样的表示可能非常有用。 他们可能有一天会治愈癌症。 然而,记住它们所揭示的模式并不存在于世界之外是很有用的,它们存在于感知者的眼中。