ONNX模型能提供通用格式来集成、部署和优化不同框架训练出的模型,对跨端部署意义重大。在跨端部署过程中需要做好系列优化工作,下面就具体展开介绍。

什么是ONNX模型:ONNX是开放式神经网络交换标准,为AI模型提供开源格式,定义了计算图形模型、内置运算符和标准数据类型。当前它主要专注推理功能,不支持训练。很多主流框架训练出的模型,都能导出或转换为ONNX标准格式,方便后续跨平台部署。

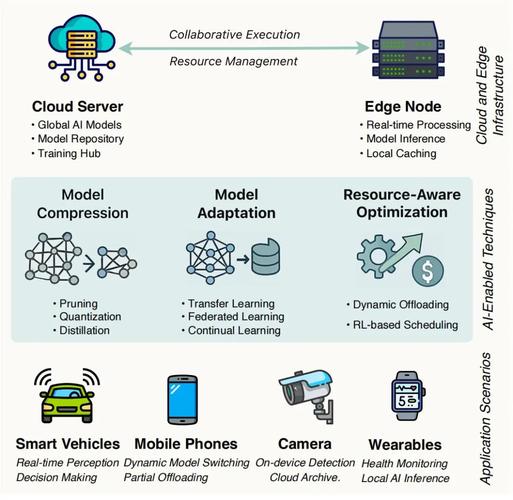

为何要跨端部署:现在常见训练框架是和,训练完的模型需集成到现有应用,部署到云端、边端等不同平台。若在每个平台实现所有模型框架,会增加环境复杂性,优化工作也很耗时,所以需要跨端部署通用方案,ONNX模型就解决了这一难题。

常见部署方案有哪些:常见的如模型先转换为onnx模型,再用部署;还有模型转onnx模型后,用部署;也可以通过MMdnn模型转换框架,将模型转换后在、caffe等框架部署。

部署优化要点是什么:模型量化是关键,可降低模型存储需求和计算量,提升推理速度。还要进行图优化,去除冗余节点和算子,简化计算图。同时,要针对不同硬件平台特点进行优化,充分发挥硬件性能。

优化后效果怎样:经过优化,能显著提升模型在不同平台的部署效率,减少资源占用,使得模型能够更快速、稳定运行。可满足一些对实时性要求高的应用场景,有效增强实际使用时的体验。

大家在ONNX模型跨端部署优化中遇到过什么难题呢?欢迎评论分享,觉得有用还请点赞和转发。